在企業急於導入生成式 AI 的浪潮中,基礎架構的選型往往面臨兩難:如何在控制軟體授權成本的同時,極大化昂貴 GPU 硬體的利用率?全新的Red Hat AI Enterprise正是為了回應此挑戰而生的整合型解決方案。

強大的 Inference Server 與模型開發工具鏈。

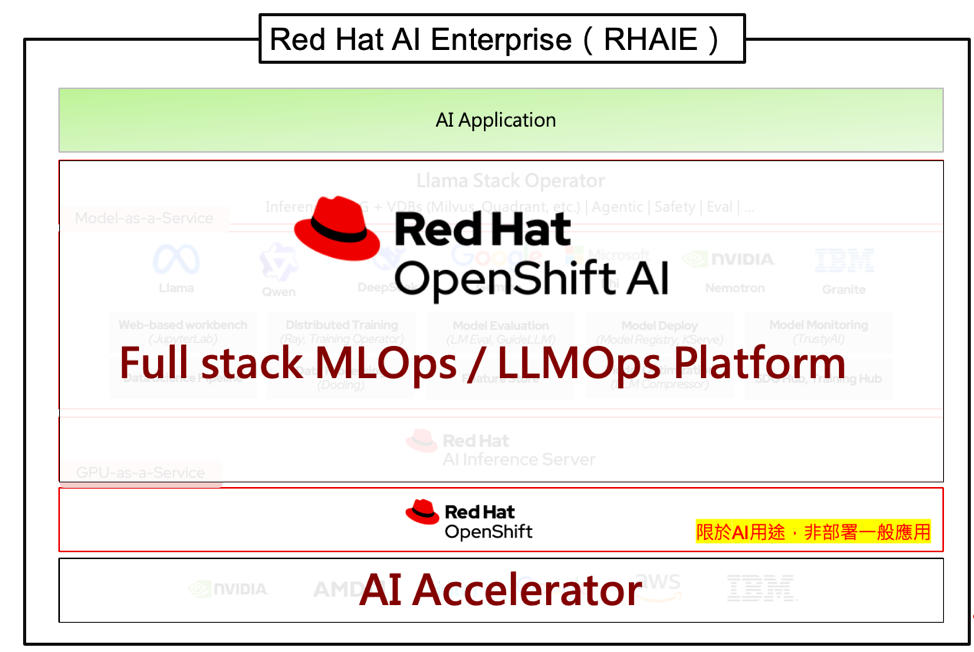

作為底層基礎,僅專注於運行 AI 專案,而非一般應用開發。

專用硬體加速功能,適用於市面上加速晶片,例如:NVIDIA、Intel、AMD晶片等等。

而新的授權方式帶來眾多戰略優勢,由授權模式、架構整合與資源效率三個維度深入探討。

在未有Red Hat AI Enterprise授權前,若客戶有AI專案的需求,需分別獨立購買OpenShift、OpenShift AI、有多少張GPU卡需購買相應AI Accelerator套數。前兩者有虛擬機(2Core or 4vCPU)或實體機(Bare-Metal)計價,後者則依卡數做購買。然而,Red Hat AI Enterprise採取了極具競爭力的「以節點計算」授權模式(實體或虛擬節點皆可),單一節點就包含以上三種產品,相較之下,成本計算複雜度降低,同一台節點不管裝了多少張 GPU(或未來擴到更多卡),授權費用不會跟著「卡數」線性上升,此模式能有效降低不確定性,讓客戶更敢把硬體買足、把效能跑滿。

對於已經部署 Red Hat OpenShift的企業客戶而言,導入 AI Enterprise方案是升級 AI 能力最自然的途徑。

許多企業的數據與微服務應用已經運行在現有的Red Hat OpenShift 上,透過疊加或並行部署Red Hat AI Enterprise,您可以讓一般容器應用服務與 AI 推論服務處於極近的網路拓樸中。這不僅解決了跨雲或跨資料中心的延遲問題,更確保了數據處理的合規性與安全性。

對於新潛在客戶,即便一般應用不是跑在Red Hat OpenShift上,而是跑在企業內部其他軟體,Red Hat AI Enterprise依然具備強大的吸引力:

企業購買 GPU 硬體後,最怕的是資源利用率低落。透過調度能力,本方案支援多種 GPU 共享技術,開發人員在進行模型開發或輕量級推論時,不怕訓練一個模型,佔用整張實體卡。可以將一張強大的 GPU 切分給多個AI場景使用。

透過 Kubernetes 原生的調度機制,閒置的算力可以被自動回收並重新分配,確保每一分硬體投資都在產生價值。

免去客戶自行拼裝多個元件的需求、可以安裝於公有雲、混合雲、邊緣部署,並提供已測試驗證且受支援的 AI 堆疊,協助自動化 DevOps/MLOps/Gen AIOps 工作流程;把 AI 安全、監控與可觀測性列為上線重點。

全新的Red Hat AI Enterprise(RHAIE)帶來了更具優勢的計價模式與更專注的 AI 運行環境。作為企業 AI 轉型的「特種部隊」——以最精簡的授權成本,駕馭最強大的硬體算力。無論是為了降低延遲而與現有應用搭配,還是為了高效管理 GPU 資源池,這都是面向未來的明智投資。

您是否想進一步了解 Red Hat AI Inference Server 在實際 IT 營運場景的作用?MetaAge 邁達特是 Red Hat 台灣總代理,擁有近 30 年雲地整合、混合多雲治理的實戰經驗。邁達特不僅提供產品授權,更專精於規劃、導入與客製化您的策略,確保自動化效益能在您的 IT 環境中真正落地並持續擴展。

您可由此填寫 【免費諮詢表單】聯繫邁達特顧問團隊,讓邁達特的 Red Hat 認證工程師為您量身打造以自動化為核心的雲端治理策略,助您掌握混合雲管理全局。